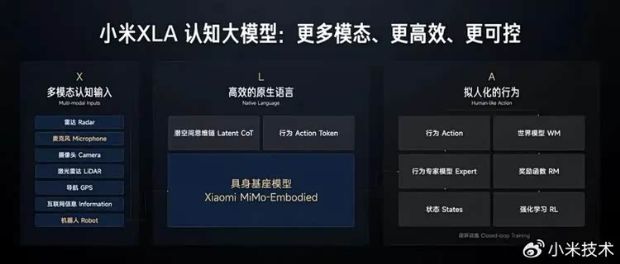

5月13日,小米正式发布——Xiaomi OneVL:一步式潜空间语言视觉推理框架。该模型在业内率先实现VLA、世界模型、潜空间推理等多个技术路线的统一,在具备XLA模型强悍推理能力的基础上,大幅提升了推理的速度和精度,在精度上超越显式CoT、在速度上对齐“仅答案”预测的潜空间CoT方案。

小米技术发文称,我们将Xiaomi OneVL的模型权重和训练、推理代码全面开源,与全球开发者共同推动自动驾驶的进步和迭代。我们相信,这不只是一次对XLA的功能补充,而是对XLA技术路线中“潜空间推理”能力的一次深度探索。

今天,小米技术研发团队在Latent CoT的基础上进一步探索自动驾驶大模型中的潜空间推理问题,正式推出——Xiaomi OneVL:一步式潜空间语言视觉推理框架。

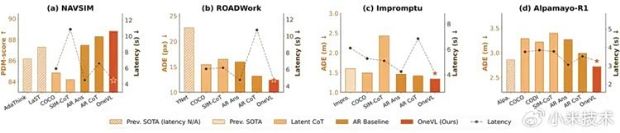

作为XLA架构中Latent CoT能力的首次学术验证,Xiaomi OneVL是首个在精度上超越显式思维链、在速度上对齐“仅答案”预测的潜在推理方案,并实现了VLA与世界模型的统一。

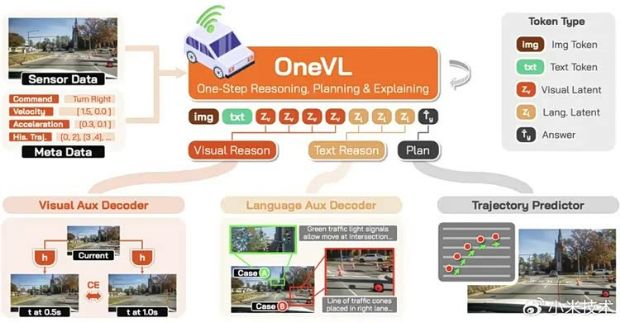

通过“语言推理 + 视觉未来预测”的双重监督,Xiaomi OneVL将可解释性与世界模型的未来预测能力统一到latent reasoning中,为自动驾驶大模型探索出一条新的精度—效率平衡路径。

从这个意义上说,Xiaomi OneVL进一步验证了XLA架构方向的技术潜力:真正面向现实世界的辅助驾驶,不只要看见当下,更要理解因果、预判未来,并在有限时间内完成高质量决策。

过去,VLA和世界模型是自动驾驶领域两条相对独立的技术路线:VLA专注于理解场景并输出驾驶动作,世界模型专注于预测未来场景的演变。Xiaomi OneVL通过潜空间推理,首次将两者统一到同一套框架中。

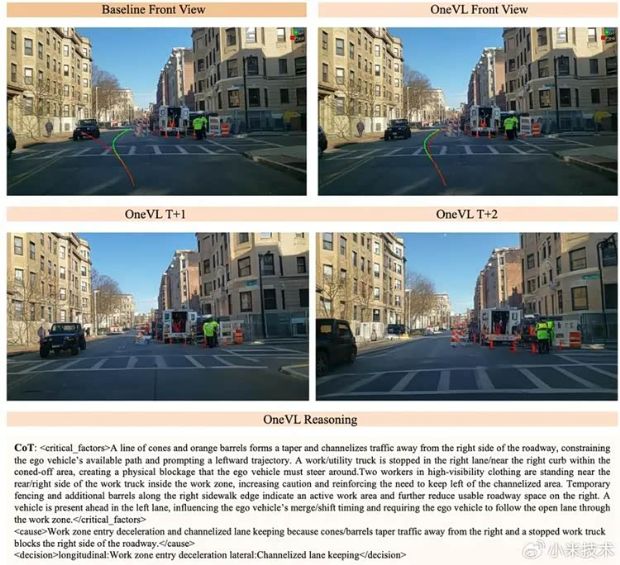

它的核心洞察是:自动驾驶要压缩的,不只是语言推理,而是对未来世界变化的理解。 驾驶决策真正依赖的,并不只是“前方有车”“道路变窄”这样的语义描述,而是车辆运动、道路几何、障碍物演变等时空因果信息。压缩语言,丢掉的恰恰是最关键的因果结构;而压缩成“对未来视觉世界的预测”,才保留了真正决定驾驶结果的东西。

基于这一洞察,Xiaomi OneVL 提出三项关键技术。简单来说:让模型用自己的“内部语言”思考、让它学会预测未来画面、并把整个推理过程压缩到一步完成。

在涵盖感知、推理与规划的多个主流基准上,Xiaomi OneVL全面刷新了潜在推理方法的性能上限。

同时,Xiaomi OneVL能为模型决策提供语言和视觉双维度的可解释性——既能用文字说明“为什么这样开”,也能用预测画面展示“接下来会发生什么”,将XLA所追求的“理解与推理”能力,真正落到了可验证、可解释的工程实践中。

小米官方称:Xiaomi OneVL模型与代码现已全面开源,欢迎全球开发者与研究人员共同参与,探索自动驾驶大模型的无限可能。